AI’s worden op veel verschillende fronten ingezet en dit zorgt voor snelle ontwikkelingen in de economie, zorg, marketing en andere sectoren. Maar het brengt ook gevaren met zich mee. Daarom heeft de Europese Unie een wetgeving voor AI aangemaakt om evenwicht te brengen tussen de ontwikkelingen en risico’s in AI’s. Leer alles over wat de AI-act nu eigenlijk is, welke AI wetten hieraan verbonden zijn en de impact hiervan op marketing.

AI in een notendop

AI staat voor kunstmatige intelligentie, dit is een verzamelnaam voor verschillende soorten computersystemen die bepaalde taken kunnen uitvoeren waarvan werd gedacht dat menselijke intelligentie vereist was. Zulke soort taken zijn: Leren, plannen, redeneren, problemen oplossen, beslissingen nemen en veel meer. Dit wordt in het dagelijks leven al vaak toegepast, denk aan de gezichtsherkenning van een telefoon, hulpsystemen zoals Siri en Google Assistant en chatbots zoals ChatGPT, Jasper en Google Gemini.

AI-systemen bereiken deze resultaten door het analyseren van grote hoeveelheden data online, waaruit algoritmes patronen leren herkennen, dit wordt machine learning genoemd. Maar dit brengt ook gevaren met zich mee: De snelle evolutie van AI maakt het moeilijk om alle potentiële gevolgen te overzien en kan leiden tot onvoorspelbare uitkomsten.

De AI-wetgeving: Een diepgang in de AI-act

Wat is de AI-wetgeving?

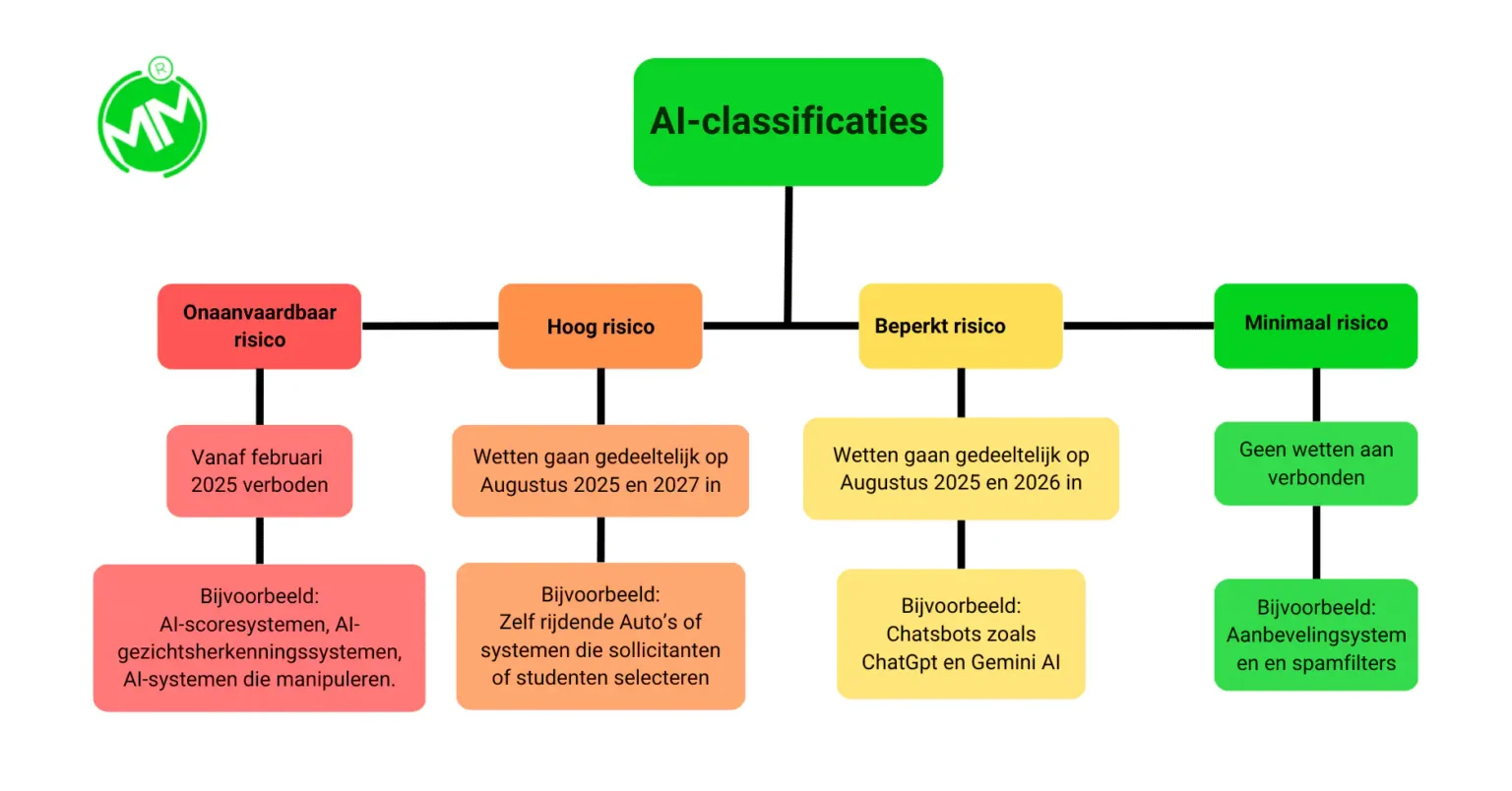

De AI-wetgeving, of ook wel de AI-act genoemd, is een verzameling van wetten gemaakt om evenwicht te vinden tussen de bescherming van publieke waarden en het vertrouwen in AI tegenover het houden van de innovatieve vooruitgang in verschillende sectoren. Daarom zijn de AI-systemen ingedeeld in vier verschillende risico segmenten met hun eigen regels (Zie: De vier verschillende AI-classificaties).

De Europese AI-act is sinds 1 augustus 2024 in werking getreden, maar de volledige opvolging zal in fases gebeuren. Dit betekent dat niet meteen alle regels van toepassing zullen zijn en dat dit in bepaalde fases zal worden geïmpliceerd.

Het belang van de AI-wetgeving

AI helpt Europa enorm met het ontwikkelen en uitvoeren van dagelijkse taken, maar de groei van de AI-ontwikkeling gaf een toenemend verlangen voor regelgeving en duidelijkheid. AI-algoritmes kunnen namelijk enorm grote hoeveelheden data verzamelen over gebruikers om gepersonaliseerde advertenties te tonen. Dit roept vragen op over privacy en toestemming. Verder moeten consumenten erop kunnen vertrouwen dat hun data veilig is en niet misbruikt wordt. Hier moeten dus duidelijk wetten aan zitten verbonden. Ook zijn er AI-algoritmes in de zorg, vervoer en economie die kritisch toezicht vereisen voor de veiligheid.

Maar privacy en veiligheid zijn niet de enige problemen. AI-systemen kunnen ook een gebrek hebben aan transparantie. AI’s kunnen niet altijd uitleggen hoe ze tot een beslissing zijn gekomen, terwijl dit wel essentieel is voor het begrijpen van het resultaat. Verder kunnen er nog andere problemen ontstaan, zoals bij schade. Wie is er aansprakelijk als er een ongeluk plaatsvindt door een AI in het ziekenhuis? De programmeur, het ziekenhuis of de verkoper van het systeem?

Om deze gevallen te voorkomen moeten er duidelijke en strenge grondregels komen, vandaar het belang van de AI-wetgeving.

Het AI-pact: een vrijwillige toevoeging

Wat is het AI-pact?

Het AI-pact is een vrijwillig initiatief waarbij bedrijven afspraken maken over de ethische ontwikkeling en het gebruik van AI. Het is dus geen wet, maar een soort gedragscode.

Door dit pact willen bedrijven een gemeenschappelijke blik op AI creëren, concrete maatregelen nemen en het vertrouwen van het publiek winnen. Het pact vergadert over onderwerpen zoals ethische principes, risicobeoordeling en menselijk toezicht. Verder wordt er in het pact belangrijke informatie gedeeld om elkaar te helpen bij het aanpassen op de AI-act.

Op dit moment hebben over 100 verschillende bedrijven het AI-pact getekend, waaronder grote producenten zoals: Google, Amazon, OpenAI en Microsoft. Er missen wel nog een paar grote bedrijven zoals Meta, Apple en TikTok.

Het verschil tussen de AI-act en het AI-pact

- De AI Act is bindend voor alle bedrijven die AI-systemen ontwikkelen of gebruiken in de EU. Terwijl het AI-pact vrijwillig is.

- De AI Act bevat specifieke regels over bijvoorbeeld transparantie, veiligheid en niet-discriminatie. Het AI-pact maakt hierbij aanvullende afspraken die binnen het pact zijn afgesproken.

De impact van de AI-wetgeving op verschillende soorten AI-software.

De vier verschillende AI-classificaties

In de AI-act zijn de verschillende AI’s opgesplitst in vier categorieën. Hier is voor gekozen wegens een grote differentiatie van AI-algoritmes met een breed scala aan risico’s. Vandaar passen er andere regels bij verschillende AI’s. Hieronder staan de vier risico’s kort uitgelegd.

Onaanvaardbaar risico

Onaanvaardbare risico’s zijn AI’s die een te groot risico vormen voor de veiligheid van de maatschappij. Hieronder liggen bijvoorbeeld AI’s die zijn gecreëerd om mensen te manipuleren en AI-scoresystemen die mensen classificeren door middel van gedrag of persoonlijke kenmerken. Daarnaast liggen AI-gezichtsherkenningssystemen die in het openbaar mensen identificeren zonder een goede reden ook onder de onaanvaardbare risicogroep.

Hoog risico

Dit zijn AI-systemen die een hoog risico vormen voor de veiligheid, gezondheid of een gevaar bieden voor menselijke rechten. Denk hierbij aan zelfrijdende auto’s en AI’s die sollicitanten of studenten selecteren.

Beperkt risico

AI-systemen met een beperkt risico zijn AI’s die een gebrek hebben aan transparantie of informatiestrekking. Denk hierbij aan chatbots zoals ChatGpt, DALL-E en Gemini AI.

Minimaal risico

De minimale risicogroep is de grootste groep binnen de AI’s. De AI’s die hieronder vallen, mogen gratis worden gebruikt en hebben geen eigen wetten. Dit omvat aanbevelingssystemen voor vergelijkbare producten en muziek of spamfilters.

Uit welke wetten bestaat de AI-act?

Onaanvaardbaar risico

Omdat het risico zo hoog ligt bij dit soort AI-systemen, is er besloten dat ze verboden zullen worden begin volgend jaar.

Door dit soort AI-algoritmes te verbieden wil de Europese Unie bepaalde zaken voorkomen: De schending van privacy, bedreiging in beveiliging en discriminatie/manipulatie door AI’s. De wetten voor het verbod zullen op 2 februari 2025 ingaan.

Hoog risico

AI-systemen met een hoog risico moeten voldoen aan strenge eisen op het gebied van transparantie, menselijk toezicht en gegevensbescherming.

Dit wordt onder andere bereikt door procedures te gebruiken om mogelijke gevaren op tijd te identificeren om schade te voorkomen. Verder moet er een hoge kwaliteit aan data worden aangeleverd aan AI’s om risico’s op discriminatie te voorkomen. Verder zullen er passende maatregelen voor menselijk toezicht zijn om de risico’s te minimaliseren.

Beperkt risico

Bij beperkte risico AI-systemen moet de gebruiker altijd bewust worden gemaakt dat hij niet met een echt persoon praat, maar met een kunstmatige intelligentie. Bovendien moet alle AI-gegenereerde content identificeerbaar zijn, en content die is gemaakt om te informeren, moet duidelijk worden bestempeld als AI-geproduceerd.

AI wet voor ontwikkelaars en gebruikers

Partijen die betrokken zijn bij de ontwikkeling, het aanbieden, het gebruik, het toezicht en het onderzoek naar kunstmatige intelligentie zijn verplicht om zichzelf te houden aan bepaalde wetten en regelgeving. Het beheersen van AI-geletterdheid is hierbij essentieel. Dit vraagt een diepgaand inzicht van de eigenschappen, mogelijkheden, beperkingen en risico’s over kunstmatige intelligentie.

Werkgevers moeten ervoor zorgen dat medewerkers over de noodzakelijke AI-kennis beschikken en deze up-to-date houden. Verder moet er worden kunnen aangetoond hoe AI binnen het werkproces is ingezet. Bij het gebruik van AI is het verplicht om klanten hierover te informeren.

Lees hier meer informatie over de gefaseerde wetten van de AI-wetgeving.